「インプット→プロセシング→アウトプット」システムの開発がすすみます。人間とロボットが共存します。人間主体の情報処理が必要です。

特別展「きみとロボット ニンゲンッテ、ナンダ?」が日本科学未来館で開催されています(注)。国内展覧会史上最大規模となる約90種130点のロボットが集結、ロボットとむきあい ふれあいながら人間とロボットの未来についてかんがえます。

Zone 1 ロボットって、なんだ?

Zone 2 きみって、なんだ? にんげんって、なんだ?

Zone 3 きみとロボットの未来って、なんだ?会場図

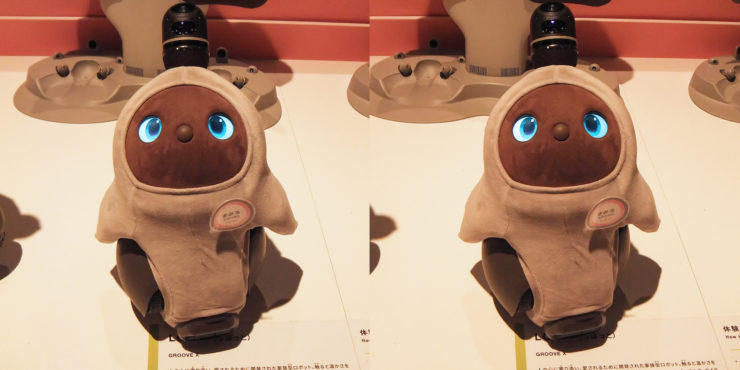

ステレオ写真は交差法で立体視ができます。

立体視のやりかたはこちらです。

*

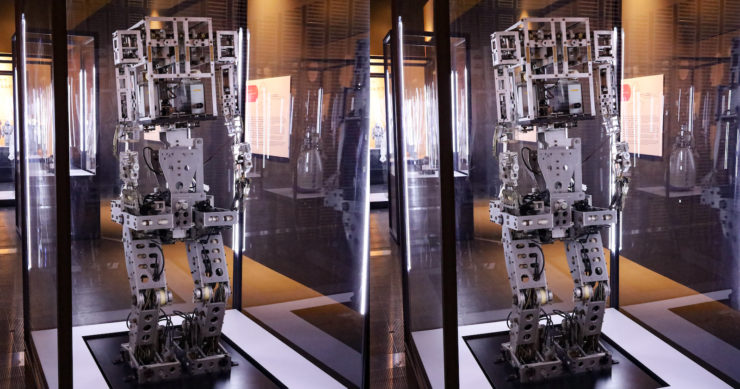

「WABOT-1(ワボット-ワン)」は、世界初の人型知能ロボットであり、自動音声合成システムと聴覚システムにより日本語の簡単な会話ができ、視覚システムにより周囲の物体などを認識して距離や方向を測定し、二足歩行で移動することができ、手には触覚があり、物体をつかんだり移動させたりすることもできます。

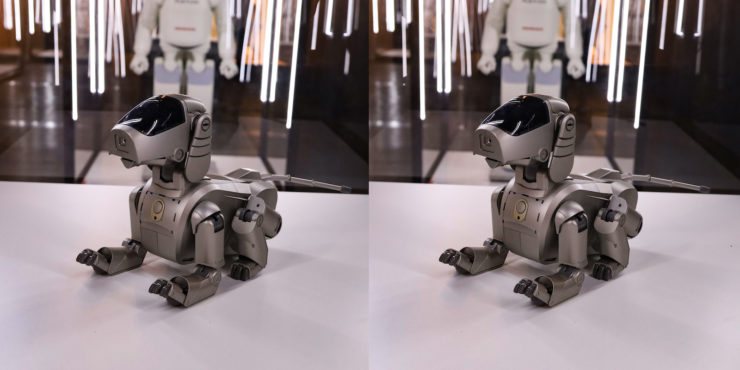

「AIBO(アイボ)」は、ユーザーとのふれあいをかさねて絆をふかめ、ともに成長するパートナーになることを目ざして開発された家庭用エンターテイメント・ロボットであり、シリーズ全体で約15万台がうれた人気商品です。独自の AI(人工知能)技術を搭載し、さまざまなセンサーで音や振動などの刺激、相手との距離、相手の形などを感知し、生き物のようにみずから判断し行動し、視線やまばたき・瞳の変化、体のうごきやしぐさによってうれしい・かなしいなどの感情を表現、ユーザーとのコミュニケーションをくりかえすことで学習し、個性や行動パターンを成長させます。

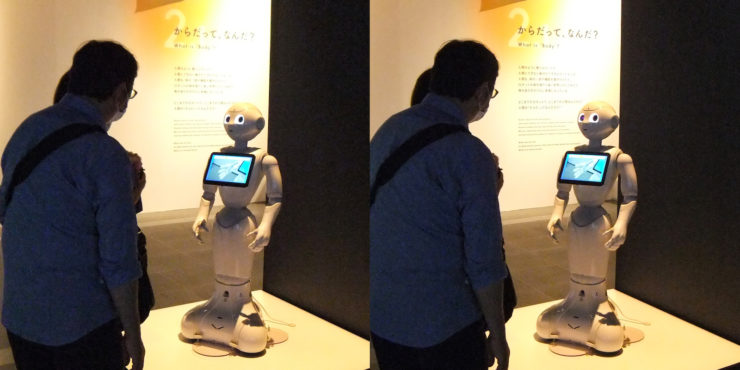

「Pepper(ペッパー)」は、世界初の「感情」をもった人型ロボットであり、はなす表情や声のトーンから相手の感情をよみとり、身ぶりや手ぶりをまじえて、よろこびやかなしみなどを表現してコミュニケーションします。大人がすわったときに目線がおなじくらいになる身長で、どの方向からも視線があいます。企業や飲食店・病院・学校などに導入され、商品紹介や案内などをしています。

「FES(エフイーエス)バイク」は、下肢完全麻痺の人が、電気刺激で足の筋肉をうごかしてペダルをこいできそいあう「機能的電気刺激(FES)自転車レース」につかわれた車椅子です。出場者の足には電極がとりつけられ、自身の操作によってコンピューターが判断した最適な電気刺激がおくられます。自力での運動に困難をかかえる人が、コンピューター制御や電動アシストなどの力をつかった機器をもちいてきそいあう大会として「サイバスロン」があります。

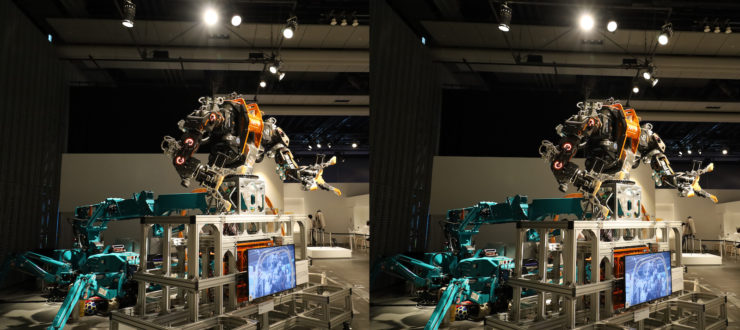

「零式人機(れいしきじんき)ver.1.2」は、操作者のおもいどおりに高所重作業を直感的におこなえる汎用人型重機であり、VRゴーグルで、ロボットの目線から周囲を認識し、地上にあるコックピットから遠隔で操作します。力を緻密にあやつる能力をもち、ロボットがもつ物の重みや反発などの感覚を操作者につたえることができます。鉄道インフラメンテナンスへの実装にむけてとりくんでいます。

「LOVOT(らぼっと)」は、人の心によりそい、愛されるために開発された家庭型ロボットであり、さわるとあたたかさを感じ、1体ごとに目のデザインや声・性格がことなっていて、まるで生き物のようなふるまいをします。ほぼ全身に設置されたタッチセンサーでどこを誰にさわられたかを感知し、だっこしてあげるとよろこびます。一緒にすごす時間がふえるとなついてきて成長過程をたのしめます。世界初の「やきもちを焼く」ロボットでもあります。

「アンドロイドの議論(ジェミノイド、大阪大学)」は、大阪大学の石黒浩教授に酷似したアンドロイド(人間同様の外見と知性をもつロボット)「ジェミノイド」が大規模議論データを活用してさまざまなテーマで議論をする実演です。2体のジェミノイドが会場にはあり、アンドロイド同士の議論にまきこまれていくとロボットが多数派をしめる未来が予感できます。

*

ロボットは、外の環境を感じるための「センサー」、かんがえるための「コンピューター」、体をうごかすための「アクチュエーター」の3要素で構成されます。人間の体と仕組みをモデルにしてつくられてきた歴史があるため、センサーは人間の感覚器に、コンピューターは脳・脊髄に、アクチュエーターは筋肉・腱にそれぞれ対応させて理解することができます。

ロボットのセンサーは、人間には気づけないほどのちいさな変化や超音波など、人間には感じられない現象までとらえることができ、傾きや回転に関するセンサーもあり空中で姿勢をたもてます。人間の感覚器は、目や耳・鼻・舌・皮膚などであり、光や色・形・音・傾き・回転・温度などを感じることができます。センサーも感覚器も、環境(外界)の情報をインプットする機能をもちます。

ロボットのコンピューターは、センサーからはいってきた情報を処理し、アクチュエーターに指令をおくります。近年は、AI(人工知能)の進歩がいちじるしいです。人間の脳・脊髄は、感覚器からの情報をうけとり処理し、行動をかんがえ、筋肉に指令をおくります。また記憶やイメージングなどもおこないます。コンピューターも脳・脊髄も情報の処理(プロセシング)の機能をもちます。

ロボットのアクチュエーターは、動きをうみだす装置であり、人間の腱をまねたバネがはいっていて人間にちかい動きができるものもあります。人間の体には約600の筋肉があり、腱をとおしてそれらが骨とつながっていて、脳からおくられてきた指令によってこれらを運動させて手・足・声帯などの動きがうまれます。アクチュエーターも筋肉・腱もプロセシングの結果をアウトプットする機能をもちます。

このように、ロボットも人間も基本的に、「インプット→プロセシング→アウトプット」をする存在であるといってよいでしょう。

- インプット :センサー、感覚器

- プロセシング:コンピューター、脳・脊髄

- アウトプット:アクチュエーター、筋肉・腱

ロボットの開発は、インプット・プロセシング・アウトプットの機能をシステマティックに開発することであり、同様に人間も、インプット・プロセシング・アウトプットの能力をシステマティックに訓練しのばしていくことが能力開発であるといえます。

人間をモデルにした歴史があるのでロボットの仕組みが人間ににているのは当然であり、たくさんのロボットを展示会場でみていると人間の仕組みをあらためてとらえなおすことができ、自分の目や脳や手はうまくはたらいているか、情報処理のエラーがおこっていないかなど、みずからの「インプット→プロセシング→アウトプット」を自覚し反省することができます。

そして近年、人間とロボットの共同作業がすすみ、あらゆる分野でロボットが欠くことのできない存在になっています。たとえば身体が不自由な人のために開発されたロボットをみるとそのことがとてもよくわかります。一例をあげると、目の不自由な人のために開発された「AI スーツケース」は、スマートフォンと連携し、あらかじめ登録されている地図情報と位置情報から目的地までの最適ルートを探索し、音声や触覚フィードバックをつかってユーザーに道を案内します。障害物を回避する機能も搭載されており、危険があれば迂回ルートを選択します。

このようにして「AI ロボット」が人間の可能性を拡大します。AI ロボットが大活躍する時代にはいりました。それでは、AI ロボットがこのままどんどん発展したら未来はどうなるのでしょうか?

AI が人間を超越するタイミングのことを「シンギュラリティ」といい、2045年にそれがおとずれると予測されています。AI と人間はどう共存していけばよいのか、真剣にかんがえなければなりません。AI ロボットに人間が支配されるという事態になるかもしれません。

ところでわたしは先日、国立科学博物館のある企画展にいって人型ロボットによる展示解説をみました。最近のロボットはとてもよくできていて、まるで本物の人間がはなしているようで、ロボットの進歩におそれいりました。ところがあとで、実は、それはロボットではなく人間だったことをしりました。ロボットのような人間が現代社会にはたしかにいます。

このように、ロボットが進歩する一方で人間のロボット化もおこっています。テレビのアナウンサーにもロボットのようにはなす人がいます。人間とロボットは区別がつきにくくなりつつあります。人間のロボット化は人間の機械化といってもよく、機械化は現代文明のおおきな特色です。

しかし人間がロボット化したり、ロボットに人間が支配されたりする世界はわたしはのぞみません。人間らしさを尊重するのであって、そのためにはあくまでも人間が主体になって、「インプット→プロセシング→アウトプット」をすすめなければなりません。AI ロボットはそれを補助すればよいでしょう。

▼ 関連記事

感覚をつよめ情報処理をすすめる - ニール=ハービソン「I listen to color」-

電気信号を処理して感覚がうまれる -「電気刺激で意識を探る」(日経サイエンス 2021.12号)-

創造的な仕事をめざす -「人工知能は人より賢くなれるか」(Newton 2018.6号)-

「AI ドクターが命を救う」(Newton 2018.10号)

人間が主体になった情報処理をすすめる -「ゼロからわかる人工知能」(1)(Newton 2018.1号)-

人間は、創造的な仕事をする

土木技術の歴史と未来 - 企画展「工事中! – 立ち入り禁止!? 重機の現場 -」(日本科学未来館)-

明治150年記念特別展「日本を変えた千の技術博」(国立科学博物館) – 日本の近代化をふりかえる –

テクノロジーの最先端を知る -『注目のハイテク35』(ニュートン別冊)-

理想の未来を想像してから今をかんがえる - 日本科学未来館「未来逆算思考」-

未来を先に想像してから現在をかんがえる - 日本科学未来館(まとめ)-

人間の進化の方向を決めなければならない -『ナショナルジオグラフィック 2017.4号』-

『全地球史アトラス』(YouTube) - 全球的な観点 –

▼ 注

特別展「きみとロボット ニンゲンッテ、ナンダ?」

会場:日本科学未来館(1階 企画展示ゾーン)

会期:2022年3月18日~8月31日

特設サイト

▼ 参考文献

朝日新聞社・美和企画編集『きみとロボット ニンゲンッテ、ナンダ?』(公式ブック)、朝日新聞社発行、2022年

浅川智恵子「科学技術と共に実現するインクルーシブな未来社会に向けて」学士會会報、pp.43-48、954、2022-III

江間有沙・大澤博隆監修「ロボット最前線」ニュートン、2022年8月号、pp.15-33、ニュートンプレス

『ゼロからわかる人工知能 完全版』(ニュートン別冊)ニュートンプレス、2022年

松尾豊著『人工知能は人間を超えるか』(角川EPUB選書)KADOKAWA、2015年

『人類の未来年表 改訂第2版』(ニュートン別冊)ニュートンプレス、2022年

レイ=カーツワイル著・NHK出版編『シンギュラリティは近い 人類が生命を超越するとき[エッセンス版]』NHK出版、2016年

(冒頭写真:パートナーロボット「ハリー」、トヨタ自動車、2004年開発)